Rede de crenças profundas - Deep belief network

| Parte de uma série sobre |

|

Aprendizado de máquina e mineração de dados |

|---|

|

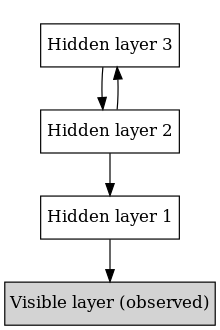

No aprendizado de máquina , uma rede de crença profunda ( DBN ) é um modelo gráfico generativo ou, alternativamente, uma classe de rede neural profunda , composta por várias camadas de variáveis latentes ("unidades ocultas"), com conexões entre as camadas, mas não entre as unidades dentro cada camada.

Quando treinado em um conjunto de exemplos sem supervisão , um DBN pode aprender a reconstruir probabilisticamente suas entradas. As camadas, então, atuam como detectores de recursos . Após esta etapa de aprendizagem, um DBN pode ser treinado posteriormente com supervisão para realizar a classificação .

Os DBNs podem ser vistos como uma composição de redes simples e não supervisionadas, como máquinas Boltzmann restritas ( RBMs ) ou autoencoders , em que cada camada oculta da sub-rede serve como camada visível para a próxima. Um RBM é um modelo baseado em energia não direcionado e generativo com uma camada de entrada "visível" e uma camada oculta e conexões entre, mas não dentro das camadas. Esta composição leva a um procedimento de treinamento não supervisionado, camada por camada, onde divergência contrastiva é aplicada a cada sub-rede por sua vez, começando do par de camadas "mais baixo" (a camada visível mais baixa é um conjunto de treinamento ).

A observação de que os DBNs podem ser treinados avidamente , uma camada por vez, levou a um dos primeiros algoritmos de aprendizado profundo eficazes . No geral, existem muitas implementações e usos atraentes de DBNs em aplicativos e cenários da vida real (por exemplo, eletroencefalografia , descoberta de medicamentos ).

Treinamento

O método de treinamento para RBMs proposto por Geoffrey Hinton para uso com modelos de "Produto de Especialistas" de treinamento é chamado de divergência contrastiva (CD). CD fornece uma aproximação para o método de máxima verossimilhança que seria idealmente aplicado para aprender os pesos. No treinamento de um único RBM, as atualizações de peso são realizadas com gradiente descendente por meio da seguinte equação:

onde, é a probabilidade de um vetor visível, que é dado por . é a função de partição (usada para normalizar) e é a função de energia atribuída ao estado da rede. Uma energia mais baixa indica que a rede está em uma configuração mais "desejável". O gradiente tem a forma simples onde representam as médias em relação à distribuição . O problema surge na amostragem porque isso requer uma amostragem Gibbs alternada estendida . O CD substitui esta etapa executando a amostragem de Gibbs alternada para as etapas (valores de bom desempenho). Após as etapas, os dados são amostrados e essa amostra é usada no lugar de . O procedimento do CD funciona da seguinte maneira:

- Inicialize as unidades visíveis para um vetor de treinamento.

- Atualizar as unidades escondidas em paralelo dadas as unidades visíveis: . é a função sigmóide e é o viés de .

- Atualizar as unidades visíveis em paralelo dadas as unidades ocultas: . é o preconceito de . Isso é chamado de etapa de "reconstrução".

- Atualize novamente as unidades ocultas em paralelo, dadas as unidades visíveis reconstruídas usando a mesma equação da etapa 2.

- Executar a atualização de peso: .

Depois que um RBM é treinado, outro RBM é "empilhado" sobre ele, recebendo sua entrada da camada final treinada. A nova camada visível é inicializada para um vetor de treinamento e os valores para as unidades nas camadas já treinadas são atribuídos usando os pesos e tendências atuais. O novo RBM é então treinado com o procedimento acima. Todo esse processo é repetido até que o critério de parada desejado seja atendido.

Embora a aproximação de DC à probabilidade máxima seja grosseira (não segue o gradiente de nenhuma função), ela é empiricamente eficaz.

Veja também

- Rede bayesiana

- Aprendizagem profunda

- Rede convolucional de crenças profundas

- Modelo baseado em energia

Referências

links externos

- "Deep Belief Networks" . Tutoriais de aprendizado profundo .

- "Exemplo de rede de crenças profundas" . Tutoriais Deeplearning4j . Arquivado do original em 03/10/2016 . Página visitada em 22/02/2015 .