Transpor - Transpose

Na álgebra linear , a transposição de uma matriz é um operador que vira uma matriz sobre sua diagonal; isto é, ele troca os índices de linha e coluna da matriz A produzindo outra matriz, freqüentemente denotada por A T (entre outras notações).

A transposição de uma matriz foi introduzida em 1858 pelo matemático britânico Arthur Cayley . No caso de uma matriz lógica representando um binário relação R, os corresponde a transposição para a relação inverso R T .

Transpor de uma matriz

Definição

A transposta da matriz A , denotada por um T , ⊤ Um , Um ⊤ , , A ' , A TR , t Um ou uma t , pode ser construído por qualquer um dos métodos que se seguem:

- Reflita A sobre sua diagonal principal (que vai da parte superior esquerda para a parte inferior direita) para obter A T

- Escreva as linhas de A como colunas de A T

- Escreva as colunas de A como as linhas de A T

Formalmente, o i -ésimo linha, j -ésimo elemento da coluna de A T é o j -ésimo linha, i -ésimo elemento da coluna de A :

Se A é uma matriz m × n , então A T é uma matriz n × m .

No caso de matrizes quadradas, A T também pode denotar o t th poder da matriz Uma . Para evitar uma possível confusão, muitos autores usam upperscripts esquerdo, isto é, eles denotam a transposta como T A . Uma vantagem dessa notação é que não são necessários parênteses quando expoentes estão envolvidos: como ( T A ) n = T ( A n ) , a notação T A n não é ambígua.

Neste artigo, essa confusão é evitada por nunca usar o símbolo T como um nome de variável .

Definições de matriz envolvendo transposição

Uma matriz quadrada cuja transposta é igual a si mesma é chamada de matriz simétrica ; ou seja, A é simétrico se

Uma matriz quadrada cuja transposta é igual ao seu negativo é chamada de matriz simétrica inclinada ; isto é, A é assimétrico se

Uma matriz quadrada complexa cuja transposta é igual à matriz com cada entrada substituída por seu conjugado complexo (denotado aqui com uma linha sobreposta) é chamada de matriz Hermitiana (equivalente à matriz sendo igual a sua transposta conjugada ); isto é, A é hermitiano se

Uma matriz quadrada complexa cuja transposta é igual à negação de seu conjugado complexo é chamada de matriz skew-hermitiana ; isto é, A é inclinado-hermitiano se

Uma matriz quadrada cuja transposta é igual à sua inversa é chamada de matriz ortogonal ; ou seja, A é ortogonal se

Uma matriz quadrada complexa cuja transposta é igual ao seu inverso conjugado é chamada de matriz unitária ; ou seja, A é unitário se

Exemplos

Propriedades

Sejam A e B matrizes ec um escalar .

-

- A operação de tomar a transposta é uma involução ( autoconversa ).

-

- A transposição respeita a adição .

-

- Observe que a ordem dos fatores se inverte. Disto pode-se deduzir que uma matriz quadrada A é invertível se e somente se A T é invertível e, neste caso, temos ( A −1 ) T = ( A T ) −1 . Por indução, esse resultado se estende ao caso geral de matrizes múltiplas, onde encontramos que ( A 1 A 2 ... A k −1 A k ) T = A k T A k −1 T … A 2 T A 1 T .

-

- A transposição de um escalar é o mesmo escalar. Junto com (2), isso afirma que a transposta é um mapa linear do espaço de matrizes m × n para o espaço de todas as matrizes n × m .

-

- O determinante de uma matriz quadrada é o mesmo que o determinante de sua transposta.

- O produto escalar de dois vetores de coluna a e b pode ser calculado como a única entrada do produto da matriz:

- que é escrito como a i b i na convenção de resumo de Einstein .

- Se A tiver apenas entradas reais, então A T A é uma matriz semidefinida positiva .

-

- A transposta de uma matriz invertível também é invertível, e sua inversa é a transposta da inversa da matriz original. A notação A −T às vezes é usada para representar qualquer uma dessas expressões equivalentes.

- Se A é uma matriz quadrada, então seus autovalores são iguais aos autovalores de sua transposta, uma vez que compartilham o mesmo polinômio característico .

Produtos

Se A é uma matriz m × n e A T é sua transposta, então o resultado da multiplicação da matriz com essas duas matrizes dá duas matrizes quadradas: AA T é m × m e A T A é n × n . Além disso, esses produtos são matrizes simétricas . Com efeito, o produto de matriz AA T tem entradas que são o produto interior de uma fila de uma com uma coluna de um T . Mas as colunas de A T são as linhas de A , de modo que os corresponde entrada para o produto interno de duas fileiras de A . Se p i j é a entrada do produto, que é obtido a partir de linhas de i e j em um . A entrada p j i também é obtida a partir dessas linhas, portanto, p i j = p j i , e a matriz do produto ( p i j ) é simétrica. Da mesma forma, o produto A T A é uma matriz simétrica.

Uma rápida prova da simetria de AA T resulta do fato de ser sua própria transposta:

Implementação da transposição da matriz em computadores

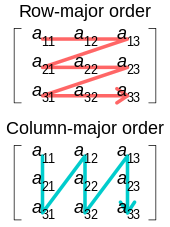

Em um computador , muitas vezes pode-se evitar a transposição explícita de uma matriz na memória simplesmente acessando os mesmos dados em uma ordem diferente. Por exemplo, bibliotecas de software para álgebra linear , como BLAS , normalmente fornecem opções para especificar que certas matrizes devem ser interpretadas em ordem transposta para evitar a necessidade de movimentação de dados.

No entanto, ainda existem várias circunstâncias nas quais é necessário ou desejável reordenar fisicamente uma matriz na memória para sua ordem transposta. Por exemplo, com uma matriz armazenada em ordem de linha maior , as linhas da matriz são contíguas na memória e as colunas são descontíguas. Se operações repetidas precisam ser realizadas nas colunas, por exemplo, em um algoritmo de transformação rápida de Fourier , a transposição da matriz na memória (para tornar as colunas contíguas) pode melhorar o desempenho aumentando a localidade da memória .

Idealmente, pode-se esperar transpor uma matriz com armazenamento adicional mínimo. Isso leva ao problema de transpor uma matriz n × m no local , com O (1) armazenamento adicional ou, no máximo, armazenamento muito menor do que mn . Para n ≠ m , isso envolve uma permutação complicada dos elementos de dados que não é trivial para implementar no local. Portanto, a transposição de matriz in-loco eficiente tem sido o assunto de inúmeras publicações de pesquisa em ciência da computação , começando no final dos anos 1950, e vários algoritmos foram desenvolvidos.

Transpostas de mapas lineares e formas bilineares

Lembre-se de que as matrizes podem ser colocadas em uma correspondência um-para-um com operadores lineares . A transposta de um operador linear pode ser definida sem a necessidade de considerar uma representação matricial dela. Isso leva a uma definição muito mais geral da transposta que pode ser aplicada a operadores lineares que não podem ser representados por matrizes (por exemplo, envolvendo muitos espaços vetoriais de dimensão infinita).

Transposição de um mapa linear

Deixe- X # denotar o espaço dual algébrico de um R - módulo X . Deixe que X e Y ser R -modules. Se u : X → Y é um mapa linear , então seu adjunto algébrico ou dual , é o mapa # u : Y # → X # definido por f ↦ f ∘ u . O funcional u # ( f ) resultante é chamado de recuo de f por u . A seguinte relação caracteriza o adjunto algébrico de u

- ⟨ U # ( F ), x ⟩ = ⟨ f , u ( x )⟩ para todos os f ∈ Y ' e X ∈ X

onde ⟨•, •⟩ é o emparelhamento naturais (isto é definido por ⟨ z , h ⟩: = H ( z ) ). Esta definição também se aplica inalterada aos módulos à esquerda e aos espaços vetoriais.

A definição da transposta pode ser vista como independente de qualquer forma bilinear nos módulos, ao contrário da adjacente ( abaixo ).

O espaço dual contínuo de um espaço vetorial topológico (TVS) X é denotado por X ' . Se X e Y são TVSs, então um mapa linear u : X → Y é fracamente contínuo se e somente se u # ( Y ' ) ⊆ X ' , caso em que deixamos t u : Y ' → X ' denotar a restrição de u # para Y ' . O mapa t u é chamado de transposta de u .

Se a matriz A descreve um mapa linear em relação às bases de V e W , então a matriz A T descreve a transposta desse mapa linear em relação às bases duais .

Transpor de uma forma bilinear

Todo mapa linear para o espaço dual u : X → X # define uma forma bilinear B : X × X → F , com a relação B ( x , y ) = u ( x ) ( y ) . Ao definir a transposta desta forma bilinear como a forma bilinear t B definida pela transposta t u : X ## → X # ie t B ( y , x ) = t u (Ψ ( y )) ( x ) , encontramos que B ( x , y ) = t B ( y , x ) . Aqui, Ψ é o homomorfismo natural X → X ## no dual duplo .

Adjunto

Se os espaços vetoriais X e Y têm, respectivamente, formas bilineares não degeneradas B X e B Y , um conceito conhecido como adjunto , que está intimamente relacionado à transposta, pode ser definido:

Se u : X → Y é um mapa linear entre os espaços vetoriais X e Y , definimos g como o adjunto de u se g : Y → X satisfaz

- para todos os x ∈ X e Y ∈ Y .

Essas formas bilineares definem um isomorfismo entre X e X # , e entre Y e Y # , resultando em um isomorfismo entre o transposto e o adjunto de u . A matriz do adjunto de um mapa é a matriz transposta apenas se as bases forem ortonormais em relação às suas formas bilineares. Nesse contexto, muitos autores usam o termo transpor para se referir ao adjunto conforme definido aqui.

O adjunta permite-nos considerar se g : Y → X é igual a u -1 : Y → X . Em particular, isso permite que o grupo ortogonal sobre um espaço vetorial X com uma forma quadrática seja definido sem referência a matrizes (nem seus componentes) como o conjunto de todos os mapas lineares X → X para os quais o adjunto é igual ao inverso.

Em um espaço vetorial complexo, geralmente se trabalha com formas sesquilineares (linear-conjugada em um argumento) em vez de formas bilineares. O adjunto Hermitiano de um mapa entre tais espaços é definido de forma semelhante, e a matriz do adjunto Hermitiano é dada pela matriz transposta conjugada se as bases são ortonormais.

Veja também

- Matriz adjuvante , a transposição da matriz cofator

- Conjugado transposto

- Pseudoinverso de Moore-Penrose

- Projeção (álgebra linear)

Referências

Leitura adicional

- Bourbaki, Nicolas (1989) [1970]. Algebra I Chapters 1-3 [ Algèbre: Chapitres 1 a 3 ] (PDF) . Éléments de mathématique . Berlin New York: Springer Science & Business Media. ISBN 978-3-540-64243-5. OCLC 18588156 .

- Halmos, Paul (1974), Espaços vetoriais de dimensão finita , Springer, ISBN 978-0-387-90093-3.

- Maruskin, Jared M. (2012). Álgebra Linear Essencial . San José: Solar Crest. pp. 122–132. ISBN 978-0-9850627-3-6.

- Schaefer, Helmut H .; Wolff, Manfred P. (1999). Espaços vetoriais topológicos . GTM . 8 (segunda edição). New York, NY: Springer New York Imprint Springer. ISBN 978-1-4612-7155-0. OCLC 840278135 .

- Trèves, François (2006) [1967]. Espaços Vetoriais Topológicos, Distribuições e Kernels . Mineola, NY: Dover Publications. ISBN 978-0-486-45352-1. OCLC 853623322 .

- Schwartz, Jacob T. (2001). Introdução às matrizes e vetores . Mineola: Dover. pp. 126-132. ISBN 0-486-42000-0.

links externos

- Gilbert Strang (primavera de 2010) Álgebra Linear do MIT Open Courseware

![{\ displaystyle \ left [\ mathbf {A} ^ {\ operatorname {T}} \ right] _ {ij} = \ left [\ mathbf {A} \ right] _ {ji}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9b0864ad54decb7f1b251512de895b40545facf5)

![{\ displaystyle \ left [\ mathbf {a} \ cdot \ mathbf {b} \ right] = \ mathbf {a} ^ {\ operatorname {T}} \ mathbf {b},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/df7fe45515e81c3a4160801b7f9658f3a84af1b8)